CheckFree: навчання з відмовостійкістю без контрольних точок

Ця наукова робота описує CheckFree — новаторський метод відновлення після збоїв у розподіленому навчанні, який не вимагає створення контрольних точок (checkpointing) або виконання надлишкових обчислень, що забезпечує ефективне навчання навіть за умови частих збоїв.

Основні моменти

- Прискорення до 1,6 разів порівняно з традиційними контрольними точками: CheckFree і CheckFree+ можуть досягати прискорення часу навчання до 1,6 разів порівняно з традиційними контрольними точками при частих збоїах на етапах навчання.

- Нова методика відновлення без контрольних точок: CheckFree використовує ваги сусідніх етапів для апроксимації ваг втраченого етапу.

Передумови

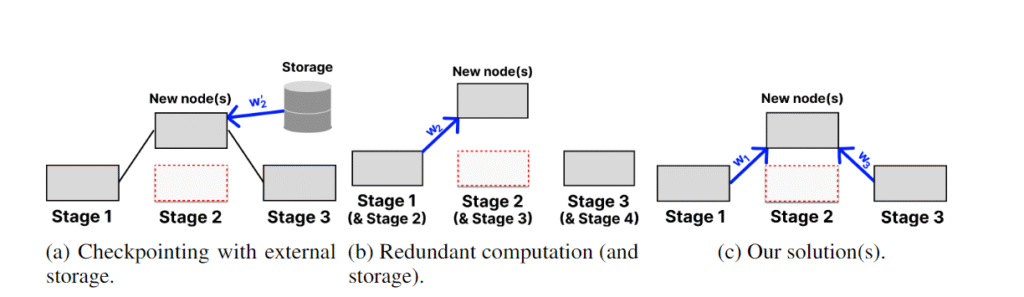

В сучасних стратегіях відновлення вага моделі зберігається (чекпоінтиться) періодично на надійному централізованому сховищі. Це може бути надзвичайно витратним, наприклад, створення однієї контрольної точки для моделі LLaMa 70B займає більше 20 хвилин при високошвидкісному з’єднанні (припускаючи швидкість понад 500 Мбіт/с). Коли відбувається збій, модель відкотиться повністю до попередньої контрольної точки, втрачаючи потенційно години навчання. Bamboo запропонував альтернативу чекпоінтингу — надмірні обчислення, зберігаючи ваги етапу на попередньому етапі та виконуючи кожен мікропакет уперед на копіях. Таким чином, при збої навчання може бути негайно відновлено. Однак таке навчання виявляється неефективним для великих моделей, оскільки кожен вузол повинен подвоїти свої вимоги до пам’яті для зберігання надмірних шарів. CheckFree і CheckFree+ надають життєздатну альтернативу в масштабованому георасподіленому навчанні, оскільки не вимагають додаткових обчислень чи комунікацій.

Як це працює

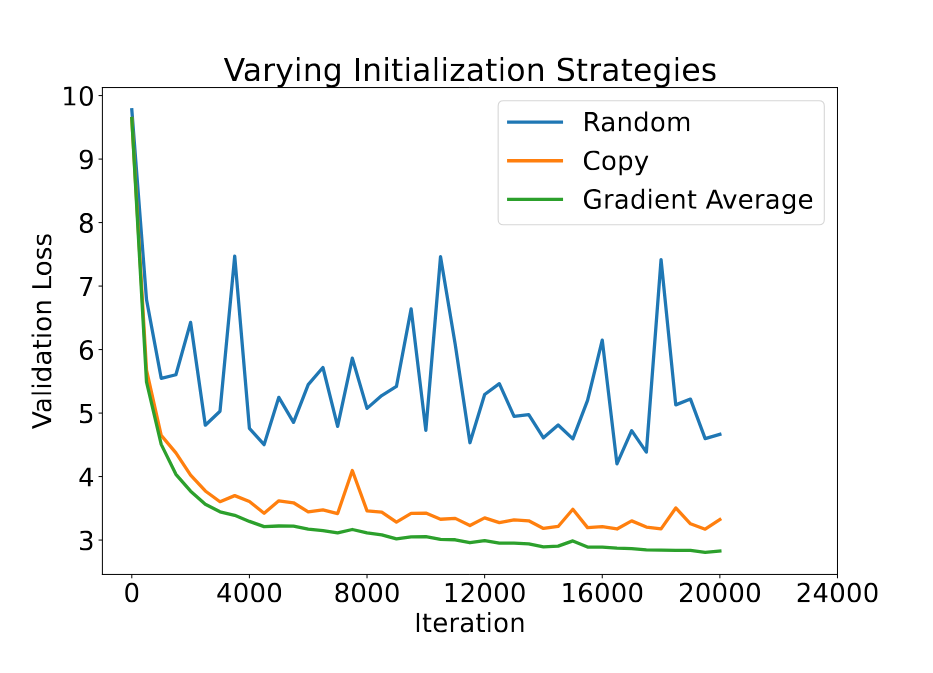

Коли відбувається збій, втрачене значення відновлюється шляхом зваженого середнього двох сусідніх етапів. Це використовує природну надмірність шарів в LLM, як показано в попередніх роботах, де видалення кількох шарів не має значного впливу на продуктивність моделі. Ми емпірично демонструємо, що усереднення значно перевершує просте копіювання, зазвичай використовуване в роботах по стекуванню шарів.

Простий спосіб усереднення — це рівномірне усереднення двох етапів. Таке усереднення, однак, не враховує важливість і збіжність етапів, що призводить до повільнішої збіжності всієї моделі. Тому CheckFree використовує ваги останньої норми градієнта даного етапу. Концептуально це дає більшу вагу етапам, які ще не зійшлися, частково розвантажуючи їх функціональність на новий етап. Щоб дозволити нещодавно ініціалізованому етапу «надолужити пропущене», CheckFree трохи збільшує швидкість навчання на кілька кроків після відновлення.

Однак ця стратегія не може відновити ваги першого та останнього етапів, оскільки немає сусідніх етапів для усереднення. Для цього ми пропонуємо CheckFree+. Він дозволяє відновлювати крайні етапи, використовуючи виконання позачергово: кожен другий пакет змінює порядок перших двох та останніх двох етапів, дозволяючи проміжковим шарам вивчати поведінку своїх сусідів, подібно до надмірних обчислень, але без додаткових накладних витрат на пам’ять або обчислення. У разі збою «надмірні» етапи можуть бути скопійовані для заміни відсутніх.

Результати

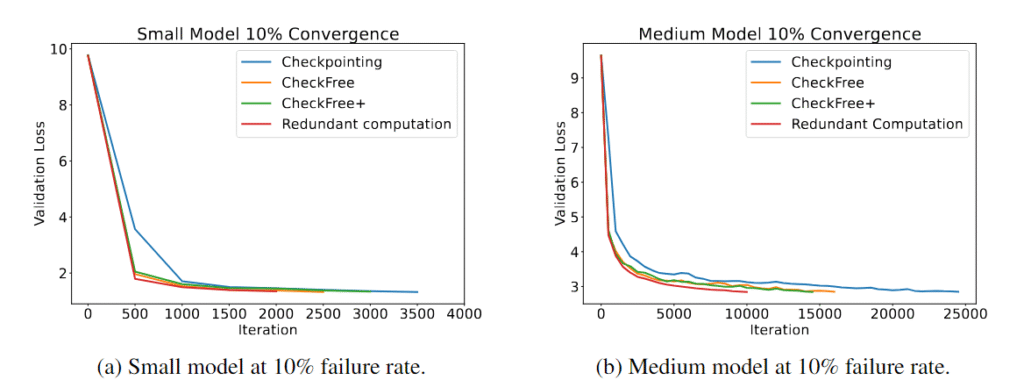

Ми широко оцінюємо CheckFree і CheckFree+ при частоті збоїв від 5% до 16% на годину порівняно з традиційними контрольними точками та надмірними обчисленнями. Ми спостерігаємо, що на різних розмірах моделей CheckFree і CheckFree+ можуть сходитися швидше за час реального навчання порівняно з сучасними методами. Однак наші методи призводять до зниження збіжності по ітераціях відносно базової лінії без збоїв (збіжність, еквівалентна надмірним обчисленням). Але завдяки своїй легкій процедурі відновлення CheckFree і CheckFree+ можуть мати значно вищу пропускну здатність, що робить їх добре підходящими для георасподіленого навчання великих мовних моделей.

Чому це важливо

У децентралізованому навчанні вузли можуть входити та виходити з мережі в будь-який момент, що може призвести до збоїв цілих етапів. Навіть при розподіленому навчанні на наступних екземплярах може бути втрачено цілий етап, якщо відповідні вузли заплановані в одному регіоні. Контрольні точки можуть нести великі накладні витрати через часті перезапуски, тоді як надмірні обчислення можуть бути неможливі для великих моделей через лінійне збільшення пам’яті. CheckFree пропонує ефективний спосіб відновлення навчання LLM без додаткових обчислень або комунікацій.

Дізнатися більше

- Прочитати статтю

- Вивчити репозиторій

- Приєднатися до обговорення: Discord · X