Verde: نظام التحقق من التعلم الآلي على العقد غير الموثوقة

هذه ورقة أكاديمية تصف “فيردي” (Verde)، وهو بروتوكول التحقق من برامج تعلم الآلة، بالإضافة إلى نظام “المشغلات القابلة لإعادة الإنتاج” (Reproducible Operators – RepOps) الأساسي الذي يمكنه. تمثل RepOps مكتبة تضمن إعادة إنتاج عمل تعلم الآلة على مستوى البت عبر أجهزة متنوعة.

شبكة Gensyn تنشئ سوقًا عالميًا حرًا للحوسبة من أجل التعلم الآلي. فهي تتيح لأي مستخدم تقديم الموارد — من مراكز البيانات إلى أجهزة MacBook — مع ضمان تنفيذ موحّد عبر جميع الأجهزة. هذا يمكّن المطورين من تدريب نماذج فائقة الحجم بتكلفة منخفضة، ويفتح أشكالًا جديدة من التعلم التعاوني التي لم تكن ممكنة من قبل.

لتحقيق هذه الفكرة، نحتاج إلى آلية للتحقق من عمل مزوّدي الخدمات غير الموثوقين بطريقة قابلة للتوسع. النهج البسيط سيكون استخدام وسيط موثوق لإعادة تنفيذ كل مهمة أو وضع المزوّدين يدويًا في قائمة بيضاء للأطراف الموثوقة. في كلا الحالتين نواجه بسرعة قيودًا على قابلية التوسع: في الحالة الأولى ستكون تكاليف التكرار غير مقبولة؛ في الحالة الثانية سنستبعد عددًا كبيرًا من المزوّدين الراغبين في المشاركة.

النهج الأكثر تعقيدًا، مثل أنظمة الإثباتات التشفيرية، يضمنون الصحة، ولكنها مكلفة للغاية لمهام ML الكبيرة (على الأقل في الوقت الحالي). أما النهج heuristic مثل Proof-of-Learning أو Proof-of-Training Data فهي تقدّم كفاءة على حساب ضعف الضمانات الأمنية.

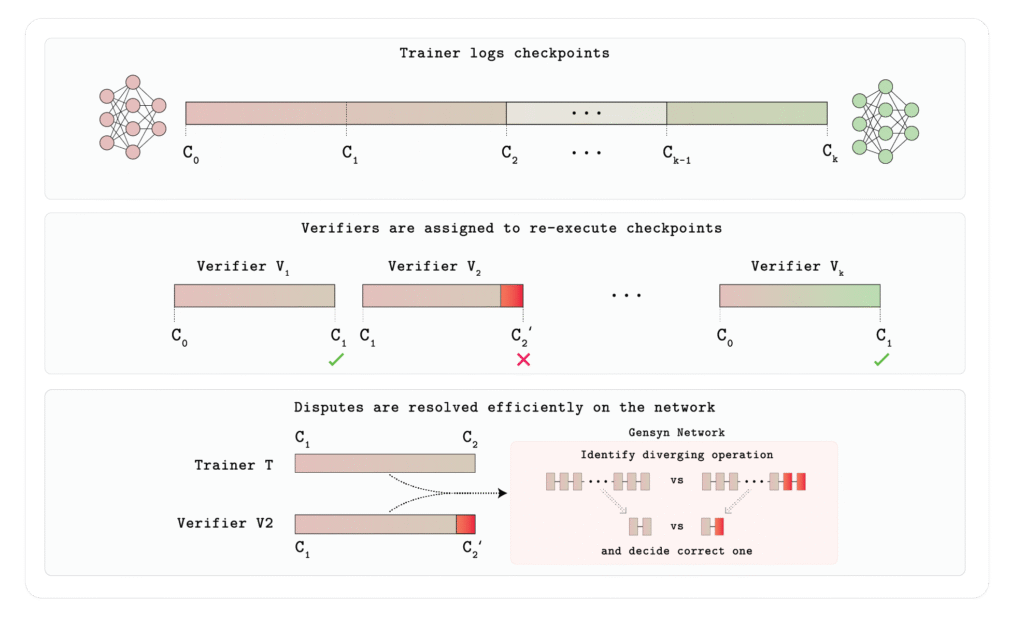

بدلاً من ذلك، نلجأ إلى فكرة delegated arbitration، التي تستخدم المدققين للتحقق من عمل كل مزوّد. إذا اعتقد المدقق أن مخرجات المزوّد غير صحيحة، يمكنه استخدام لعبة فعّالة لحل النزاع لإقناع محكّم محايد بذلك. هذه التقنيات تشكّل أساس optimistic verification المستخدمة في blockchain rollups مثل Arbitrum وOptimism، حيث يعمل مدققو البلوكشين كجهة تحكيم. النزاعات على كتل كاملة من المعاملات يمكن حلها …

ومع ذلك، فإن delegated arbitration لا تتماشى جيدًا مع التعلم الآلي الحديث لسببين. أولاً، تم تصميمها لبرامج تعمل على CPU ولا تُترجم بكفاءة إلى الشبكات العصبية واسعة النطاق. ثانيًا، تفترض أن الخوادم الصادقة دائمًا ستحسب نفس النتيجة لبرنامج واحد، وهو ما لا يكون صحيحًا غالبًا في ML عند استخدام أجهزة مختلفة.

أي آلية قابلة للتطبيق يجب أن تعالج هذه المشكلات بطريقة قابلة للتوسع.

تقديم Verde

اليوم نحن سعداء بتقديم Verde — أول بروتوكول تحقق مصمّم خصيصًا للتعلم الآلي الحديث في البيئات اللامركزية.

يتكون Verde من نظام خفيف لحل النزاعات، يحدد الخطوة الأولى في التدريب والمشغّل (operator) في الرسم البياني الحسابي للشبكة العصبية الذي يختلف حوله المدرّب والمدقق. الآن، بدلًا من إعادة تنفيذ المهمة بالكامل، يقوم المحكّمون — الذين قد يكونون smart contract أو لجنة من المدققين — بإعادة حساب هذا المشغّل المتنازع عليه فقط. هذا يقلل بشكل كبير من التكاليف العامة للتحقق، مع ضمان أنه إذا كان هناك مدقق واحد صادق على الأقل، فسيتم توفير النتيجة الصحيحة.

قابلية إعادة الإنتاج

لكي يعمل هذا النظام، نحتاج إلى أن تكون برامج ML قابلة لإعادة الإنتاج على جميع إعدادات الأجهزة، بحيث أن العقد المختلفة (الصادقة) ستحسب نفس النتيجة بغض النظر عن الجهاز المستخدم. عادةً، هذا لا يحدث بشكل افتراضي، حتى بالنسبة لأجهزة من نفس الشركة المصنعة (مثل Nvidia A100 مقابل H100).

لحل هذه المشكلة، قمنا بإنشاء Reproducible Operators (RepOps)، وهي مكتبة تنفّذ نسخًا بتية قابلة لإعادة الإنتاج من مشغّلات ML الشائعة. هذا يحل مشكلة عدم التحديد (non-determinism) في الأجهزة، من خلال ضمان ترتيب ثابت لتنفيذ العمليات ذات الفاصلة العائمة عند حساب وظائف مثل ضرب المصفوفات. هذا يضمن أن المزوّدين الصادقين سيعطون دائمًا نتائج متطابقة بتياً، مما يتيح لبروتوكول حل النزاعات Verde أن يعمل بشكل موثوق.

الخاتمة

Verde يوفّر نظام البناء الأساسي للتعلم الآلي اللامركزي. فهو يتيح لـ Gensyn توصيل كل جهاز حوسبة في العالم — من مراكز البيانات إلى الأجهزة الطرفية — بطريقة قابلة للتوسع ودون الحاجة إلى إذن.

للاطّلاع على المزيد حول هذا، يمكنك قراءة المستند الكامل هنا.

لرؤية كيفية عمل قابلية إعادة الإنتاج باستخدام RepOps في عرض حي، اتبع التعليمات هنا.